Dans mon "L'IA a besoin d'un nouveau réseau"La semaine dernière, j'ai noté que NVIDIA a annoncé un chiffre d'affaires de $13 milliards d'euros dans le domaine des réseaux. sur $18,4 milliards d'euros de revenus annuels des centres de données. Cette semaine, nous approfondissons un peu plus l'économie unitaire des GPU, du réseau Hedgehog AI et des LLM proposés par les clients Hedgehog.

3,3 millions de GPU vendus

Morgan Stanley estime que NVIDIA a vendu 608 000 GPU au cours du trimestre qui s'est achevé le 28 janvier.ce qui porte le nombre total d'unités vendues depuis 2021 à plus de 3,3 millions. Nous supposons de manière prudente que les 3,3 millions de GPU sont activement utilisés sur le terrain (Total Active GPUs).

$3,900 FMV du réseau AI

Si l'on divise simplement le nombre total de GPU actifs par $13 milliards d'ARR, on obtient un quotient de $3 900 en ARR par GPU. Cette ARR de mise en réseau est principalement destinée à Infiniband les abonnements, qui connectent les GPU d'égal à égal dans les réseaux d'entraînement en arrière-plan.

Une décision facile à prendre en matière de retour sur investissement

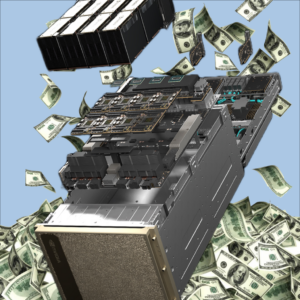

Le réseau d'IA Hedgehog exploite la valeur de votre investissement coûteux en GPU

Le chiffre de $3 900 par an semble élevé - jusqu'à ce que vous considériez le coût et la valeur d'un GPU. Morgan Stanley estime que le prix de vente moyen d'un GPU H100 est de 130 000 TTP, et que le prix de vente moyen de tous les GPU vendus au cours du dernier trimestre était de 21 700 TTP. Lorsque vous considérez le montant que vous dépensez pour un GPU, payer 18 à 20% de plus pour garantir une utilisation maximale de votre GPU est une évidence, surtout lorsque les calculs (voir ci-dessous) montrent un incroyable retour sur investissement (ROI).

Ethernet gagnera rapidement

Le groupe Dell'Oro note que "800 Gbps [Ethernet] devrait constituer la majorité des ports des réseaux dorsaux de l'IA d'ici à 2025." Cela signifie que $13 milliards de NVIDIA Infiniband ARR migreront vers Ethernet. Le changement de marché se fera au fur et à mesure que les clients de Hedgehog déploieront notre réseau d'IA haute performance.

Hedgehog ne fait pas cela tout seul. Nous construisons des logiciels de réseaux d'IA qui fonctionnent avec le matériel de partenaires tels que Ram Velaga à Broadcom et le L'équipe Spectrum X chez NVIDIA. Nous pouvons offrir de meilleures performances que l'Ethernet traditionnel pour les charges de travail d'IA à un coût total de possession bien inférieur à celui de l'Infiniband. En fait, nous prévoyons que nous pouvons également offrir de meilleures performances qu'Infiniband.

Des observateurs du secteur comme M. Dell'Oro reconnaissent que "l'on pourrait dire que le [matériel] Ethernet a une génération de vitesse d'avance sur InfiniBand". La vitesse du réseau n'est cependant pas le seul facteur. Les mécanismes de contrôle de la congestion et de routage adaptatif sont également importants". Ces mécanismes de contrôle de la congestion et de routage adaptatif nécessitent un logiciel de Hedgehog pour fournir une solution complète de réseau IA.

Le réseau Hedgehog AI offre une largeur de bande effective de 95%

NVIDIA sait que c'est inévitable. C'est pourquoi le géant technologique a annoncé son intention de lancer Spectrum X au cours de ce trimestre. L'objectif est d'améliorer la bande passante effective d'Ethernet de 35% à grande échelle. NVIDIA explique que les charges de travail liées à l'intelligence artificielle créent une congestion qui limite les réseaux Ethernet traditionnels à une bande passante effective de 60%. À l'inverse, Spectrum X a pour objectif d'augmenter les performances jusqu'à 95% de bande passante effective. Hedgehog partage cet objectif de performance avec un logiciel de contrôle de la congestion et de routage adaptatif qui utilise le matériel Spectrum X pour fournir une bande passante effective de 95% à Hedgehog.

AI Ethernet. Cela signifie que si vous investissez dans du matériel NVIDIA, Broadcom ou AMD avec des ports Ethernet à 800 Gbps, vous obtenez effectivement 760 Gbps avec un réseau Hedgehog AI. Ce chiffre est à comparer aux 480 Gbps d'un réseau Ethernet traditionnel lorsque vous exécutez des charges de travail d'intelligence artificielle.

$50 000 ROI minimum pour le réseau Hedgehog AI Network

Quelle est donc la valeur de la bande passante effective de 95% ? Pour répondre à cette question, il suffit d'étudier les prix du marché du temps GPU, puis d'établir une corrélation entre la bande passante effective du réseau d'IA et le temps d'exécution de la tâche. (Voici une source de données sur les les prix du marché pour les modèles d'inférence LLM.) À l'heure où j'écris ce billet, DeepInfra est le leader des prix à $0,27 par minute pour mixtral-8x7b, tandis qu'OpenAI facture $30/min pour GPT4. Entièrement utilisé, un seul GPU de DeepInfra a une valeur marchande annuelle théorique de $142 000. Cela n'est pas possible car le temps d'exécution des tâches est limité par la bande passante effective du réseau d'IA. Avec une bande passante effective de 60% pour l'Ethernet traditionnel, un GPU DeepInfra ne génère que $85 000 par an. Avec un réseau d'IA Hedgehog, il générera $135K pour un retour sur investissement de $50K.

Ces chiffres sont bien sûr beaucoup plus importants pour un client comme Together.AI, qui facture llama2-70b-chat à $0,90 par minute (3x ou $150 000). Si un client Hedgehog paie le prix Infiniband de $3900, le retour sur investissement est de 13X pour DeepInfra ou de 38X pour Together.AI. J'ai mentionné précédemment que nous pouvons fournir des performances comparables à un meilleur prix, de sorte que le pourcentage de retour sur investissement est en fait de beaucoup plus élevé pour les clients de Hedgehog.

Marc Austin est le directeur général et le fondateur de Hedgehog. Marc est un renard qui sait beaucoup de choses et un hérisson qui sait une grande chose. En tant que hérisson, il sait que des millions d'équipes de développement "cloud native" utiliseront les tissus de réseau ouverts Hedgehog pour déployer leurs applications sur une infrastructure "cloud" distribuée. En tant que renard, il sait beaucoup de choses grâce à son expérience de la stratégie d'automatisation à grande échelle chez Cisco, de la mise en réseau de l'Internet des objets chez Jasper, de la diffusion de médias numériques chez Amazon, du développement d'applications mobiles en fondant Canvas, de la naissance des smartphones chez AT&T, des débuts du covoiturage mobile en fondant Mobiquity, de la recherche sur Internet chez Infoseek, du commerce électronique chez Internet Shopping Network et de la direction de personnes dans l'adversité dans l'armée américaine.